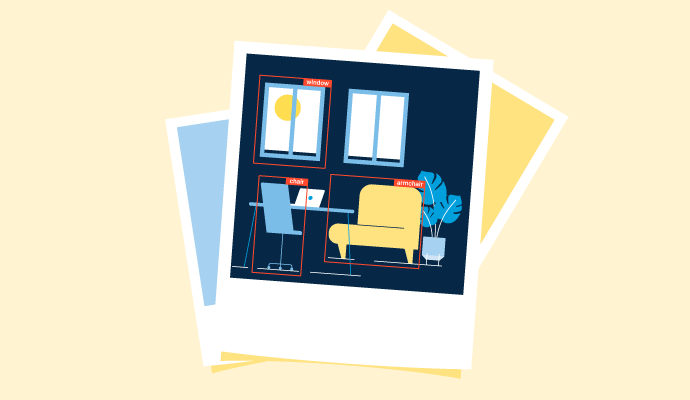

La reconnaissance d'objets a inauguré un nouveau chapitre dans la vision par ordinateur et la robotique. Alors que certaines entreprises déploient la reconnaissance d'objets pour authentifier les données biométriques et vérifier les identifiants des employés, d'autres souhaitent créer des produits d'automatisation intelligents. Améliorer la précision des appareils avec des logiciels de reconnaissance d'images conduira à une meilleure expérience consommateur et à une stabilité de la marque. Il y a eu des avancées rapides dans la reconnaissance d'objets alors que plusieurs industries comme l'automobile, la santé, le commerce électronique et le commerce de détail passent à des logiciels alimentés par l'IA. Ce qui ressort le plus, ce sont les fonctionnalités telles que la navigation dans des zones encombrées, l'obtention de services plus rapides ou le transport sans conducteur et l'imagerie médicale qui peuvent avoir un impact plus important sur l'humanité. Qu'est-ce que la reconnaissance d'objets ? La reconnaissance d'objets est une technique de vision par ordinateur qui localise, identifie et catégorise des éléments à partir d'images ou de vidéos statiques ou dynamiques. Elle gagne du terrain dans les industries qui lancent des humanoïdes, des animaux de compagnie artificiels, des appareils d'assistance automatique, des assistants domestiques et des appareils de l'Internet des objets (IoT). La reconnaissance d'objets est un sous-ensemble de l'intelligence artificielle qui extrait des informations nécessaires ou des insights critiques d'une image ou d'une vidéo. Elle vise à aider un ordinateur à voir une image existante et à la décomposer en une série de pixels pour reconnaître un motif ou une forme spécifique. Un algorithme de reconnaissance d'objets IA réussi dépend de la qualité des données nécessaires pour l'entraîner. Plus il y a de données, plus le modèle classera rapidement les objets en fonction de caractéristiques connues. La reconnaissance d'objets est un processus de pensée humaine pour déchiffrer les objets et calculer la représentation algorithmique des vecteurs à l'intérieur des objets pour les catégoriser. Types de reconnaissance d'objets La reconnaissance d'objets combine quatre techniques : la reconnaissance d'images, la localisation d'objets, la détection d'objets et la segmentation d'images. La reconnaissance d'objets décode les caractéristiques et prédit la catégorie ou la classe de l'image à travers un classificateur, par exemple, des modèles d'apprentissage supervisé comme la machine à vecteurs de support (SVM), Adaboost, Boosting ou l'arbre de décision. Les algorithmes de reconnaissance d'objets sont codés dans Darknet, un cadre de réseau neuronal open-source écrit en C, Cuda ou Python. Voici quelques types essentiels de reconnaissance d'objets : Reconnaissance d'images La reconnaissance d'images est un prédécesseur de la reconnaissance d'objets. C'est une étape critique dans tout le processus, utilisée pour prédire la catégorie de toute image donnée. Par exemple, si vous avez une photo d'un chien dans le parc, le système de reconnaissance d'images analyse les caractéristiques principales du chien : taille du visage, membres, tendons, etc., puis la compare à des milliers d'images entraînées pour afficher "chien" comme sortie. Localisation d'objets Cette technique est utilisée pour localiser l'emplacement exact de chaque type d'objet dans une image. Si vous entrez une image avec un chien et deux chats, elle crée une boîte englobante encapsulant trois choses : un chien et deux chats pour localiser les coordonnées de localisation, la hauteur et la largeur, ainsi qu'une prédiction de classe. La localisation d'un seul objet identifie une seule instance de chaque objet et renvoie son emplacement. Dans l'exemple ci-dessus, la localisation d'un seul objet renvoie la valeur d'un chien et d'un chat, éliminant ainsi le composant redondant. Détection d'objets Le système de détection d'objets est similaire au système de reconnaissance d'objets. Le but d'un système de détection d'objets est uniquement d'identifier et de classer toutes les occurrences d'un objet particulier ou d'un ensemble d'objets dans une image. Dans la détection d'objets, le système détecte automatiquement la présence d'un objet et prédit sa classe. Segmentation d'images Pour la segmentation d'images, un réseau neuronal ou un algorithme d'apprentissage automatique est entraîné pour localiser des objets individuels en fonction des pixels d'une image. Au lieu de créer une frontière, il analyse les pixels de l'objet individuellement et met en évidence leur emplacement pour déterminer la présence de l'objet. Dans le cas d'objets partiellement occultés ou cachés, le système ne renvoie aucune valeur car il ne peut pas trouver les contreparties ombragées de l'image. Par exemple, s'il y a une image de voiture, le système colore toute la voiture en rouge pour la signaler avec une prédiction de classe "voiture" et un score de confiance "de 85 %". Ce résultat détermine que le système est sûr à 85 % que l'objet dans l'image est une voiture. Reconnaissance d'objets vs détection d'objets vs segmentation d'images Les différences entre ces techniques de vision par ordinateur aux noms similaires peuvent prêter à confusion, surtout lorsqu'elles aident toutes à accomplir une tâche similaire. La reconnaissance d'objets est un terme général pour décrire un ensemble de tâches de vision par ordinateur qui impliquent l'identification de composants d'un monde réel à l'aide de la modélisation d'objets. Dans le traitement d'images numériques, la reconnaissance d'objets est utilisée pour classer des objets tangibles et intangibles, comme le fait le cerveau humain. Elle utilise une technique d'"extraction de caractéristiques" et de "regroupement de régions" pour regrouper des composants ayant des caractéristiques communes et les alimenter dans un algorithme semi-supervisé pour la classification. Le modèle de détection d'objets est un intermédiaire entre le système et l'image. Il aide à la catégorisation multi-classes d'objets entre différentes classes de données connues du modèle. La détection d'objets aide à déterminer l'essence d'une entité sous n'importe quelle forme : droite, tordue, occultée, etc. Elle est capable de signaler plusieurs occurrences d'une seule entité et de produire autant de boîtes englobantes que nécessaire. Elle ne peut pas extrapoler la surface, le volume ou le périmètre de l'objet dans l'image. La segmentation d'images est une extension de la reconnaissance d'objets. Cette technique utilise la pixelisation d'une zone particulière de l'objet ou de l'image complète. C'est une forme plus granulaire de reconnaissance d'objets dans laquelle l'image entière est scannée et délimitée par des pixels et interprétée par l'ordinateur pour trouver la catégorie pertinente. Il existe deux types de méthodes de segmentation d'images : Segmentation d'instance : Identifier les limites de chaque instance d'un objet et la représenter avec différentes couleurs, signalant la classe correcte. Segmentation sémantique : Étiqueter chaque pixel de l'image (y compris l'arrière-plan) et régler les contrastes d'illumination pour différencier les objets les uns des autres. Reconnaissance d'objets vs reconnaissance d'images La vision par ordinateur est une technologie en couches, avec une ou plusieurs tâches se fusionnant les unes avec les autres. La reconnaissance d'objets et la reconnaissance d'images en sont un témoignage. Les deux techniques ont marqué des jalons louables dans de nombreux domaines avec les mêmes avantages. La reconnaissance d'images prédit la classe d'une image ou d'une vidéo dans son ensemble. La reconnaissance d'objets identifie plusieurs objets dans une image ou une vidéo avec des étiquettes définies. Elle regroupe la classe d'image et les entiers descriptifs ensemble pour afficher la sortie clé. Elle regroupe ensemble la classe, l'emplacement, la fréquence et d'autres facteurs des objets. Les utilisateurs peuvent scanner un code de réponse rapide (QR) pour ancrer du contenu numérique sur une image. Les utilisateurs peuvent faire glisser une caméra ou un smartphone pour étiqueter des objets du monde réel en temps réel. Une classe de liste est alimentée dans le modèle d'entraînement pour identifier les images. Des algorithmes d'apprentissage automatique puissants détectent des caractéristiques inconnues pour identifier les objets. Le modèle est entraîné sur l'algorithme K-nearest neighbor Chaque objet se voit attribuer une boîte englobante qui prédit un score de confiance. Dans la chaîne d'approvisionnement, il est utilisé pour identifier certains biens et les classer comme défectueux ou non défectueux. Il aide à effectuer la reconnaissance faciale dans différents domaines pour détecter les intrus et alerter l'équipe concernée. Comment fonctionne la reconnaissance d'objets ? Un algorithme de reconnaissance d'objets réussi a deux facteurs influents : l'efficacité de l'algorithme et le nombre d'objets ou de caractéristiques dans l'image. L'idée est d'aligner l'image avec l'algorithme d'apprentissage automatique et d'extraire les caractéristiques pertinentes pour identifier et localiser les objets présents. Les caractéristiques peuvent être de nature fonctionnelle ou géométrique. Le résultat est toujours soit une prédiction de classe linéaire, soit binaire - Oui ou Non, quel que soit le modèle de données que vous déployez. Voici comment cela fonctionne : Extraction de caractéristiques Les extracteurs de caractéristiques sont les opérateurs qui décomposent une image en différentes parties déformées et extraient des composants inconnus pour la classification. Il est principalement obtenu par un algorithme d'apprentissage automatique supervisé ou un modèle de réseau neuronal convolutif (CNN) entraîné comme Alexnet ou Inception. L'algorithme crée une carte de caractéristiques de l'image pour faciliter l'identification des objets. Boîte englobante Chaque partie de l'image est enfermée dans une boîte englobante ou une boîte d'ancrage. La boîte englobante est statique pour une image mais dynamique pour l'identification d'objets dans une vidéo. C'est une frontière rectangulaire qui restreint le mouvement de l'objet ou de ses caractéristiques pour une classification plus facile. Les boîtes englobantes peuvent aider à extraire des informations telles que les coordonnées graphiques, le score de probabilité, la hauteur, la largeur, etc., ainsi que 25 autres éléments de données. Formation d'hypothèses Le nombre de caractéristiques d'image extraites et la qualité des données d'entraînement fournies à l'algorithme sont des éléments critiques de la formation d'hypothèses. Après l'extraction des caractéristiques, le système génère un score de probabilité et l'attribue aux objets présents dans l'image. Cela est principalement fait pour réduire la charge de travail d'un classificateur d'apprentissage automatique. Le résultat final est calculé en fonction du score de probabilité et de la prédiction de classe pour chaque objet dans l'image. Vérification des hypothèses À ce stade, l'hypothèse précédente est vérifiée, ce qui donne un score de classification moyen, c'est-à-dire une métrique utilisée par l'algorithme pour calculer la performance de la prédiction de classe des différents objets dans l'image. Le modèle d'IA déployé vérifie les caractéristiques pertinentes de l'objet (forme, taille, couleur, etc.) et la prédiction de classe par la boîte englobante entourant l'objet. Une fois les deux paramètres vérifiés, le système attribue un score composite final. Reconnaissance et cartographie Une fois que l'algorithme a classé les caractéristiques, il cartographie les coordonnées de la boîte englobante avec l'objet. Cette information est alimentée dans une machine à vecteurs de support (SVM) qui utilise un outil de croissance de motifs fréquents (FP) pour prédire la classe de l'objet en temps réel. Les coordonnées ou les axes sont soit analysés horizontalement, soit verticalement, étant donné le rapport d'aspect et la symétrie du plan. Régression linéaire Après la prédiction de classe, l'image passe par une régression linéaire pour trouver le tenseur exact (conteneur de données numériques renvoyé par le régressseur de l'objet). La régression est effectuée à l'aide de plateformes open-source telles que Darknet, TensorFlow ou PyTorch. Le résultat final de l'algorithme de reconnaissance d'objets comprend la catégorisation de la classe d'objet ainsi que les détails de sa boîte englobante pour spécifier l'emplacement exact de l'objet dans l'image. Saviez-vous que ? La taille du marché mondial de la reconnaissance d'images passera de 26,2 milliards de dollars en 2020 à 53,0 milliards de dollars d'ici 2025, avec un taux de croissance annuel composé (CAGR) de 15,1 % de 2020 à 2025 ! Source : MarketsandMarkets Algorithmes de reconnaissance d'objets L'approche de la reconnaissance d'objets est principalement double - algorithmes d'apprentissage automatique ou modèles de réseau neuronal convolutif (CNN) basés sur l'apprentissage profond. Pour effectuer une tâche de reconnaissance d'objets en utilisant une approche d'apprentissage automatique, vous avez besoin d'un extracteur de caractéristiques qui identifie des informations d'objet précédemment inconnues pour différencier entre les catégories d'étiquettes générales. D'un autre côté, utiliser un réseau CNN pour la reconnaissance d'objets ne nécessite pas d'extraction manuelle de caractéristiques ou de test d'hypothèses. Il peut aider à détecter directement les objets et leur emplacement en prédisant les propriétés de la boîte englobante les entourant. Continuez à lire pour découvrir certains algorithmes standard qui peuvent être utilisés pour effectuer la reconnaissance d'objets dans les industries. Algorithmes d'apprentissage automatique L'apprentissage automatique est l'une des approches les plus populaires pour vérifier la présence d'un objet. L'algorithme d'apprentissage automatique est un modèle de données d'analyse prédictive qui peut être entraîné sur de nombreuses catégories, c'est-à-dire voitures, vélos, montagnes, etc. Plusieurs algorithmes d'apprentissage automatique supervisés et non supervisés offrent de nombreuses combinaisons d'extracteurs de caractéristiques et de jeux de données de modèles qui exécutent efficacement et précisément les tâches de reconnaissance d'objets. Voyons quelques-uns d'entre eux : Algorithme de Viola-Jones L'algorithme de Viola-Jones est l'un des cadres de reconnaissance d'objets les plus populaires. Son objectif principal est de permettre au système de voir des visages humains dans une configuration droite en utilisant le processus ci-dessous : L'image capturée par une caméra ou une webcam est réduite pour créer une nouvelle image. Des caractéristiques comme la bouche ou le nez et leur relation entre elles sont programmées manuellement et ajoutées à la nouvelle image. L'algorithme de Viola-Jones fonctionne sur la nouvelle image pour créer une série d'éléments de sortie qui coïncident avec les caractéristiques existantes de l'objet. Les sorties sont alimentées dans une machine à vecteurs de support pour identifier la classe des objets dans l'image, par exemple, le visage. Peu de temps après son lancement, l'algorithme de Viola-Jones a été implémenté dans OpenCV et est devenu célèbre comme l'une des techniques les plus réussies pour effectuer la reconnaissance d'objets. Cependant, un défi qui est apparu était qu'il ne parvenait pas à identifier les objets avec une occlusion partielle ou des configurations déformées. Conseil : Un classificateur OpenCV est une approche basée sur l'apprentissage automatique utilisée pour vérifier la véracité de la classe d'objet à travers une fonction de cascade. OpenCV peut être utilisé avec n'importe quel algorithme de détection d'objets d'apprentissage automatique. Histogramme des gradients orientés Une version plus fonctionnelle de l'ancien algorithme, à savoir l'Histogramme des gradients orientés (HOGG), est sortie en 2005. HOGG était un algorithme d'apprentissage automatique amélioré largement utilisé dans la détection de piétons et le traitement d'images pour la reconnaissance d'objets. Voici comment cela fonctionne : Le système visualisait une image donnée comme une série de pixels. Pour chaque pixel, il calculait à quel point son gradient était sombre par rapport au pixel environnant. Une flèche était dessinée, pointant vers le pixel plus sombre. Ce processus se répétait jusqu'à ce que chaque pixel soit remplacé. Une matrice de flèches ou de gradients séparait l'image en petits carrés (16x16). Chaque carré pointait vers l'endroit où l'image était sombre. Des flèches qui capturaient l'essence exacte de l'objet remplaçaient les carrés. Le système comparait la sortie avec l'image originale en utilisant des métriques comme la distance euclidienne ou de Minkowski. En fonction d'une valeur seuil, il déterminait si l'image donnée était un objet ou non. HOGG est devenu extrêmement populaire car il était rapide à calculer et fournissait un modèle beaucoup plus stable pour que le classificateur d'objets fonctionne avec précision. Transformation de caractéristiques invariantes à l'échelle La transformation de caractéristiques invariantes à l'échelle (SIFT) est un algorithme de vision par ordinateur populaire qui aide à identifier les objets dans les images numériques à travers les bords des coins. Plus comme une technique de détection de bords, SIFT identifie toute la ligne de balayage d'une image et trace graphiquement des points clés spécifiques en utilisant une fonction logarithmique. Une fois les caractéristiques localisées, il transmet ces informations quantitatives ou descripteurs à un classificateur pour catégoriser les objets et trouver leur emplacement spécifique dans l'image. Algorithme de sac de caractéristiques L'algorithme "sac de caractéristiques" ou "sac de mots" analyse aléatoirement différentes caractéristiques d'un objet afin d'identifier sa catégorie. Construit sur la technologie évolutive de traitement du langage naturel (NLP), c'est un algorithme d'apprentissage automatique non supervisé qui interprète les caractéristiques du monde réel, les stocke dans un dictionnaire et améliore son algorithme pour obtenir de meilleurs résultats. Apprentissage profond L'ère de l'apprentissage profond a officiellement commencé en 2012. Avec l'essor de la technologie automobile, de la surveillance vidéo intelligente et des nouvelles normes API, les tâches de reconnaissance d'objets sont devenues relativement simples. Cependant, il y a beaucoup de travail à faire pour résoudre les problèmes de reconnaissance d'objets à travers l'apprentissage profond car cela nécessite une puissance de traitement graphique (GPU) suffisante et un grand ensemble de données d'entraînement. Le CNN est un modèle d'apprentissage profond qui résout des tâches complexes de vision par ordinateur à travers l'intelligence artificielle. Le modèle lui-même a des couches d'entrée et de sortie spécifiques qui imitent la structure du cerveau. Les couches de ce modèle représentent des axones, des dendrites, des ponts et des fibres optiques naturellement présents dans le cerveau qui alimentent le système de vision humaine. Voici quelques algorithmes d'apprentissage profond qui ont amélioré la portée de la vision par ordinateur : Réseau neuronal convolutif basé sur les régions (R-CNN) Le réseau neuronal convolutif basé sur les régions (R-CNN) est un modèle auto-entraîné performant qui fonctionne sur le jeu de données VOC-2012 et le jeu de données ILSVRC 2021. Le défi de reconnaissance visuelle à grande échelle ImageNet (ILSVRC) est une compétition académique annuelle qui a un défi séparé pour la classification d'images, la localisation d'objets et les problèmes de détection d'objets. Elle est menée dans le but de favoriser des solutions indépendantes et séparées pour chaque tâche qui peuvent être mises en œuvre à plus grande échelle. Voici un processus détaillé de reconnaissance d'images à travers R-CNN. Tout d'abord, l'utilisateur doit générer un ensemble de boîtes englobantes non catégorisées pour une image ou "régions candidates" en utilisant un algorithme de recherche sélective. À un niveau élevé, le processus de recherche sélective examine l'image à travers une série de fenêtres de différentes tailles. Chaque région candidate regroupe les caractéristiques de l'image comme la forme, la couleur, les pixels, l'intensité, etc. Ces cartes de caractéristiques d'une image sont passées à travers un modèle CNN pré-entraîné (Alexnet CNN) pour extraire les caractéristiques principales et calculer les éléments de sortie. Une fois les éléments de sortie affichés, ils sont alimentés dans un classificateur SVM pour classer les étiquettes. Simultanément, les boîtes englobantes sont passées à travers un régressseur pour localiser les coordonnées des objets ainsi que leurs catégories. Limitations de l'algorithme R-CNN Bien que R-CNN se soit avéré être un modèle significativement plus rapide pour entraîner un modèle de reconnaissance d'objets et faire des prédictions, il y avait encore quelques limitations à sa fonctionnalité. Voici un ensemble de contraintes pour R-CNN qui l'ont empêché de produire des résultats précis : La recherche sélective, Alexnet CNN et le classificateur SVM doivent tous être entraînés sur une base de données de modèles et fonctionner en utilisant de grandes quantités de puissance de traitement graphique. Entraîner un réseau neuronal simultanément sur plus de 2000 propositions de régions était fastidieux et chronophage. Le modèle compilait chaque région candidate une par une de manière séquentielle lors des tests. Comme il ne scannait pas l'image entière en une seule fois, les prédictions réelles étaient partiellement occultées et floues. Saviez-vous que ? Des modèles de reconnaissance d'objets plus efficaces ont été récemment proposés, à savoir Fast R-CNN, Faster R-CNN et Mask R-CNN. Ces algorithmes ont été pré-entraînés sur de grands ensembles de données comme VGG-16 et PASCAL VOC et produisent des prédictions de classe à la pointe de la technologie. You Only Look Once (YOLO) Tout comme l'analogie de "vous ne vivez qu'une fois", YOLO est un réseau neuronal convolutif qui analyse les données une fois pour toutes. Il a été lancé ces dernières années. Parmi toutes les approches pour effectuer des tâches de reconnaissance d'objets, YOLO est la plus précise. Il regarde une image une seule fois mais de manière intelligente. L'extraction de caractéristiques d'une image ou d'une vidéo à travers YOLO est sans résidu et entièrement transparente. Il réduit la probabilité assignée par le système qu'un objet appartienne à une classe spécifique d'une certaine quantité, ce qui donne un modèle plus stable et une classification précise des objets. Voici un aperçu standardisé de la façon dont YOLO fonctionne : L'image est divisée en une grille de 13*13 = 169 cellules de dimensions égales. Chaque cellule de l'image est responsable de la prédiction de jusqu'à 5 boîtes englobantes. À un moment donné, les boîtes englobantes chevauchent des fragments d'objets à l'intérieur de la petite cellule. Une fois qu'elle chevauche un objet, elle attribue un score de confiance prédisant si la boîte englobante a capturé un objet ou non. En plus de prédire la présence de la boîte englobante, le modèle YOLO attribue également une classe spécifique (par exemple, feux de circulation, personne, voiture, etc.) à chaque boîte englobante. Un total de 169*5 ou 845 boîtes englobantes se voient attribuer différents intervalles de confiance à travers l'image. L'intervalle de confiance est combiné avec la prédiction de classe de l'objet. En fonction d'un nombre seuil, toutes les boîtes englobantes inutiles sont éliminées, et l'image ne reste qu'avec 2 à 3 boîtes qui s'adaptent parfaitement à l'objet. Implémentation de YOLO pour la reconnaissance d'objets YOLO n'est pas un classificateur traditionnel. Le réseau neuronal fonctionne une seule fois sur l'image. Chaque cellule de la grille d'image a une valeur tensorielle spécifique. Dans ce cas, cinq boîtes englobantes sont prédites par chaque cellule. Chaque boîte englobante est responsable de l'orchestration de 25 éléments de données pour l'objet sous-jacent. Ces éléments peuvent inclure la hauteur, la largeur, les coordonnées de la boîte (bx, by), le score de probabilité ou l'intervalle de confiance. Par conséquent, la valeur tensorielle, dans ce cas, sera de 25*5 = 125. Le réseau neuronal YOLO attribue une valeur de probabilité à chaque partie de l'image, ce qui facilite l'identification et la localisation des objets dans l'image par le reconnaisseur. Conseil : La dernière version de YOLO, YOLOv2 ou YOLO9000, est une détection d'objets en temps réel à exécution unique, un CNN qui a été entraîné sur 9000 classes d'objets et peut être intégré dans un fichier .mp3 ou .mov pour prédire des boîtes englobantes en utilisant des poids pré-déclarés, un classificateur softmax et des ancres. Pourquoi l'algorithme YOLO est-il important ? Parmi toutes les approches existantes de la vision par ordinateur, YOLO donne le mieux à un ordinateur la capacité d'identifier des objets dans des environnements réels et d'interagir avec eux, presque aussi bien que les êtres humains. Comme YOLO est un réseau neuronal convolutif, il nécessite beaucoup de GPU et de données d'entraînement pour fonctionner efficacement. Voici quelques raisons pour lesquelles YOLO est l'approche de reconnaissance d'objets la plus préférée dans divers domaines d'application commerciale : Il prédit les objets dans les images en temps réel et fonctionne à une vitesse fulgurante de 45 images par seconde (FPS). Il fournit des résultats précis tout en reconnaissant des objets dans les images. Au fil du temps, il apprend à comprendre les formes et les motifs dans des images inconnues par lui-même pour classer leur catégorie. Dernières techniques de reconnaissance d'objets Mettre en œuvre une méthode simple pour la reconnaissance d'objets plutôt que des approches d'intelligence artificielle enchevêtrées est préférable. Avoir un chemin direct vers les problèmes réduit la complexité cognitive d'un problème. Cela empêche le modèle de système de collecter plusieurs images. Voici quelques techniques simples de reconnaissance d'objets que vous pouvez utiliser pour identifier des objets dans une image : Correspondance de modèles : La correspondance de modèles est une technique où l'utilisateur compare l'image avec un modèle préexistant, cartographie la similarité des caractéristiques et attribue une étiquette à l'image. Les systèmes de reconnaissance d'objets basés sur la reconnaissance de motifs fonctionnent entièrement sur des techniques de correspondance de modèles et ne nécessitent pas de formation d'hypothèses pour déterminer les objets. Transformateur visuel : Le transformateur visuel emploie une architecture de type Transformateur sur des patchs d'une image. L'image est divisée en plus petits patchs, chacun projeté sur un encodeur à l'aide d'un classificateur linéaire. La sortie est un ensemble standard de vecteurs qui rencontre un nœud de classification pour prédire la présence d'objets. La reconnaissance d'objets est-elle la même chose que la reconnaissance faciale ? La technique de reconnaissance faciale et de reconnaissance d'objets sont deux faces d'une même médaille. La reconnaissance faciale est une technologie de nouvelle génération qui reconnaît automatiquement les structures ressemblant à des visages dans une image pour déterminer son identité. En temps réel, la reconnaissance faciale aide à détecter la présence non identifiée d'êtres humains ou d'objets suspects dans un espace confiné à l'aide de caméras ou de dispositifs intégrés. L'utilité de la reconnaissance faciale s'étend à de nombreux domaines industriels différents, comme l'automatisation des processus robotiques (RPA), la détection biométrique et les opérations de défense. Applications de la reconnaissance d'objets La reconnaissance d'objets est inextricablement liée à de nombreuses applications réelles dans les domaines commerciaux. Plusieurs itérations ont été faites pour créer et affiner la reconnaissance d'objets pour les secteurs commerciaux et non commerciaux. Jusqu'à présent, les entreprises ont été raisonnablement réussies dans l'exécution de la reconnaissance d'objets en utilisant la technologie de l'IA étroite. Voici quelques systèmes d'application de reconnaissance d'objets dans la vie réelle dans différents domaines de la recherche industrielle : Sécurité et surveillance : Les bureaux et les complexes résidentiels utilisent des caméras de vidéosurveillance traditionnelles basées sur les principes de la reconnaissance visuelle d'objets. Les gens utilisent maintenant même des systèmes de sécurité pour leurs activités domestiques. Alors qu'une caméra extérieure aide à surveiller les visiteurs, les caméras intérieures aident à surveiller les actions d'un bébé. Imagerie par satellite et terrestre : La reconnaissance d'objets aide à détecter des objets dans des images aériennes et la pression atmosphérique. Elle peut également nous permettre de prédire la position des plaques tectoniques qui se déplacent à l'intérieur de notre noyau en raison de la métamorphose constante. L'assistance de la distribution de fréquence radio (RFID) permet aux pilotes et aux tours de contrôle du trafic aérien (ATC) de maintenir une communication continue entre eux. Automobiles autonomes : La reconnaissance d'objets est une partie cruciale des automobiles autonomes. Les véhicules alimentés par la reconnaissance d'objets ont la capacité de se déplacer librement sans que personne ne contrôle le volant. Pour assurer une conduite sûre, ils doivent être entièrement équipés de visibilité computationnelle. Des capteurs actifs tels que le lidar mesurent la profondeur, la position et la distance relative des objets entourant les véhicules et identifient les obstacles et les collisions. Surveillance des animaux pour la volaille : La reconnaissance et l'identification du bétail tel que les porcs ou tout autre bétail à travers plusieurs fermes sont maintenant possibles en utilisant des algorithmes de vision IA et des caméras de surveillance peu coûteuses. Comparé à d'autres méthodes, la vision IA aide à surveiller la santé et le bien-être des animaux. Cela conduit à une amélioration de la qualité des produits et de la rentabilité des produits animaux. Interaction homme-ordinateur avancée : La reconnaissance d'objets établit un canal d'interaction entre les humains et les ordinateurs dans différents domaines d'application. Elle aide à améliorer la communication bidirectionnelle entre deux gènes intelligents dépendants ou indépendants et permet l'envoi et la réception précis de signaux. Aspirateurs robots : La reconnaissance d'objets est le point de départ de l'automatisation des processus robotiques. Les aspirateurs robots comme les cyborgs et Roomba sont alimentés par la technologie de l'IA pour nettoyer les sols sans heurter quoi que ce soit. Avec l'aide d'une caméra intégrée et d'un capteur 3D, le robot reconnaît les objets à distance, les classe comme des distractions et change de direction. Reconnaissance d'objets et réalité augmentée La reconnaissance d'objets est l'un des vecteurs de performance cruciaux dans le processus de réalité augmentée. La réalité augmentée améliore la perception des utilisateurs du monde naturel à travers des images générées par ordinateur telles que des graphiques, du texte ou des sons. Avec l'aide de la reconnaissance d'objets, il devient assez simple de détecter et de manipuler des éléments réels pour transmettre des informations visuelles pertinentes et créer des expériences hautement engageantes. La reconnaissance d'objets est une technique basée sur des marqueurs qui aide à enregistrer une connexion avec un objet du monde réel et à suivre sa position en temps réel pour superposer des animations 3D par-dessus. En d'autres termes, la reconnaissance d'objets localise des points de contraste élevé, des courbes ou des bords d'objets sous différents angles pour créer un diaporama virtuel devant nos yeux. Transmettre le don de la vision aux ordinateurs Il y a des années, qui aurait pensé que l'intelligence artificielle ne serait plus connue comme la "cinquième génération d'ordinateurs", mais comme un changeur de jeu actuel pour l'humanité ? La reconnaissance d'objets passe le relais de la vision des humains aux ordinateurs. Elle a le potentiel de transformer la sphère commerciale moderne en concevant des expériences client sécurisées à la pointe de la technologie. L'avenir de la reconnaissance d'objets dépend également de l'évolution de la technologie de l'intelligence artificielle. Tout comme la révolution industrielle originale, elle réduira le travail humain à l'avenir et permettra aux humains de faire ce pour quoi ils sont mieux équipés - être créatifs et empathiques. Abordez l'étiquetage des données comme un pro avec des outils d'apprentissage actif et réduisez les coûts d'infrastructure de l'IA organisationnelle tout en maintenant la plus haute précision.

Vous voulez en savoir plus sur Logiciel de reconnaissance d'image ? Découvrez les produits Reconnaissance d'image.

Shreya Mattoo

Shreya Mattoo is a Content Marketing Specialist at G2. She completed her Bachelor's in Computer Applications and is now pursuing Master's in Strategy and Leadership from Deakin University. She also holds an Advance Diploma in Business Analytics from NSDC. Her expertise lies in developing content around Augmented Reality, Virtual Reality, Artificial intelligence, Machine Learning, Peer Review Code, and Development Software. She wants to spread awareness for self-assist technologies in the tech community. When not working, she is either jamming out to rock music, reading crime fiction, or channeling her inner chef in the kitchen.