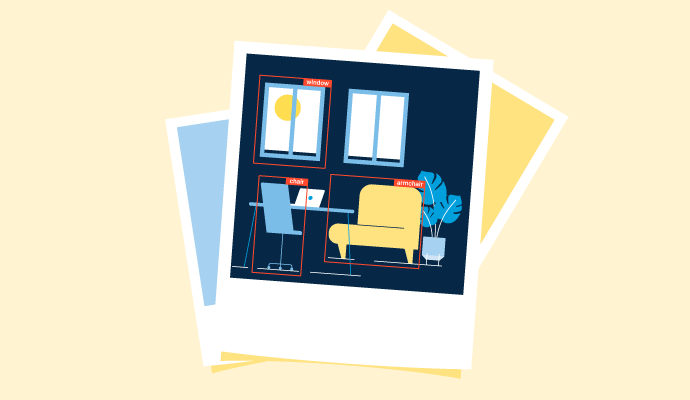

El reconocimiento de objetos ha impulsado un nuevo capítulo en la visión por computadora y la robótica. Mientras que algunas empresas implementan el reconocimiento de objetos para autenticar biometrías y verificar credenciales de empleados, otras desean construir productos de automatización inteligente. Mejorar la precisión de los dispositivos con software de reconocimiento de imágenes conducirá a una mejor experiencia del consumidor y estabilidad de la marca. Ha habido avances rápidos en el reconocimiento de objetos a medida que varias industrias como la automotriz, la salud, el comercio electrónico y el comercio minorista cambian a software impulsado por IA. Lo que más destaca son las características como la navegación en áreas concurridas, la obtención de servicios más rápidos o el transporte sin conductor y la imagen médica que pueden tener un mayor impacto en la humanidad. ¿Qué es el reconocimiento de objetos? El reconocimiento de objetos es una técnica de visión por computadora que localiza, identifica y categoriza elementos de imágenes o videos estáticos o dinámicos. Está ganando impulso en industrias que están lanzando humanoides, mascotas artificiales, electrodomésticos de asistencia automática, asistentes del hogar y dispositivos de Internet de las Cosas (IoT). El reconocimiento de objetos es un subconjunto de la inteligencia artificial que extrae información necesaria o conocimientos críticos de una imagen o video. Su objetivo es ayudar a una computadora a ver una imagen existente y descomponerla en una serie de píxeles para reconocer un patrón o forma específica. Un algoritmo exitoso de reconocimiento de objetos de IA depende de la calidad de los datos necesarios para entrenarlo. Más datos significan que el modelo clasificará más rápidamente los objetos en función de características conocidas. El reconocimiento de objetos es un proceso de pensamiento humano para descifrar objetos y calcular la representación algorítmica de vectores dentro de los objetos para categorizarlos. Tipos de reconocimiento de objetos El reconocimiento de objetos combina cuatro técnicas: reconocimiento de imágenes, localización de objetos, detección de objetos y segmentación de imágenes. El reconocimiento de objetos decodifica las características y predice la categoría o clase de imagen a través de un clasificador, por ejemplo, modelos de aprendizaje automático supervisado como Support Vector Machine (SVM), Adaboost, Boosting o Decision Tree. Los algoritmos de reconocimiento de objetos están codificados en Darknet, un marco de red neuronal de código abierto escrito en C, Cuda o Python. Aquí hay algunos tipos esenciales de reconocimiento de objetos: Reconocimiento de imágenes El reconocimiento de imágenes es un precursor del reconocimiento de objetos. Es una etapa crítica en todo el proceso, utilizada para predecir la categoría de cualquier imagen dada. Por ejemplo, si tienes una foto de un perro en el parque, el sistema de reconocimiento de imágenes analiza las características principales del perro: tamaño de la cara, extremidades, tendones, etc., y luego lo compara con miles de imágenes entrenadas para mostrar "perro" como resultado. Localización de objetos Esta técnica se utiliza para localizar el lugar exacto de cada tipo de objeto en una imagen. Si introduces una imagen con un perro y dos gatos, crea un cuadro delimitador que encapsula tres cosas: un perro y dos gatos para localizar coordenadas de ubicación, altura y ancho, junto con una predicción de clase. La localización de un solo objeto identifica solo una instancia de cada objeto y devuelve su ubicación. En el ejemplo anterior, la localización de un solo objeto devuelve el valor de un perro y un gato, eliminando así el componente redundante. Detección de objetos El sistema de detección de objetos es similar al sistema de reconocimiento de objetos. El objetivo de un sistema de detección de objetos es solo identificar y clasificar todas las ocurrencias de un objeto particular o un conjunto de objetos en una imagen. En la detección de objetos, el sistema detecta automáticamente la presencia de un objeto y predice su clase. Segmentación de imágenes Para la segmentación de imágenes, una red neuronal o un algoritmo de aprendizaje automático se entrena para localizar objetos individuales en función de los píxeles en una imagen. En lugar de crear un límite, analiza los píxeles del objeto individualmente y resalta su ubicación para determinar la presencia del objeto. En el caso de objetos parcialmente ocultos o escondidos, el sistema no devuelve ningún valor ya que no puede encontrar contrapartes sombreadas de la imagen. Por ejemplo, si hay una imagen de un coche, el sistema colorea todo el coche de rojo para señalarlo junto con una predicción de clase "coche" y una puntuación de confianza "del 85%". Este resultado determina que el sistema está 85% seguro de que el objeto en la imagen es un coche. Reconocimiento de objetos vs detección de objetos vs segmentación de imágenes Las diferencias entre estas técnicas de visión por computadora de sonido similar pueden ser confusas, especialmente cuando todas ayudan a lograr una tarea similar. El reconocimiento de objetos es un término general para describir un conjunto de tareas de visión por computadora que involucran la identificación de componentes de un mundo real utilizando modelado de objetos. En el procesamiento de imágenes digitales, el reconocimiento de objetos se utiliza para clasificar objetos tangibles e intangibles, de la misma manera que lo hace el cerebro humano. Utiliza una técnica de "extracción de características" y "agrupación de regiones" para agrupar componentes que tienen características comunes y alimentarlo a un algoritmo semisupervisado para la clasificación. El modelo de detección de objetos es un intermediario entre el sistema y la imagen. Ayuda con la categorización de múltiples clases de objetos entre diferentes clases de datos conocidas por el modelo. La detección de objetos ayuda a determinar la esencia de una entidad en cualquier forma o forma: recta, torcida, oculta, etc. Es lo suficientemente capaz de señalar múltiples ocurrencias de una sola entidad y producir tantos cuadros delimitadores como sea necesario. No puede extrapolar el área, volumen o perímetro del objeto en la imagen. La segmentación de imágenes es una extensión del reconocimiento de objetos. Esta técnica utiliza la pixelación de un área particular del objeto o la imagen completa. Es una forma más granular de reconocimiento de objetos en la que toda la imagen se escanea y se delinea por píxeles y es interpretada por la computadora para encontrar la categoría relevante. Hay dos tipos de métodos de segmentación de imágenes: Segmentación de instancias: Identificación de los límites de cada instancia de un objeto y representación con diferentes colores, señalando la clase correcta. Segmentación semántica: Etiquetado de cada píxel en la imagen (incluido el fondo) y establecimiento de contrastes de iluminación para diferenciar los objetos entre sí. Reconocimiento de objetos vs reconocimiento de imágenes La visión por computadora es una tecnología en capas, con una o más tareas fusionándose entre sí. El reconocimiento de objetos y el reconocimiento de imágenes son un testimonio de esto. Ambas técnicas han marcado hitos dignos de elogio en muchos dominios con los mismos beneficios. El reconocimiento de imágenes predice la clase de una imagen o video en su conjunto. El reconocimiento de objetos identifica múltiples objetos en una imagen o video con etiquetas definidas. Agrupa la clase de imagen y los enteros descriptivos juntos para mostrar la salida clave. Agrupa juntos, clase, ubicación, frecuencia y otros factores de objetos. Los usuarios pueden escanear un código de respuesta rápida (QR) para anclar contenido digital en una imagen. Los usuarios pueden deslizar una cámara o un teléfono inteligente para etiquetar objetos del mundo real en tiempo real. Se alimenta una lista de clases en el modelo de entrenamiento para identificar imágenes. Algoritmos de aprendizaje automático potentes detectan características desconocidas para identificar objetos. El modelo se entrena en el algoritmo K-nearest neighbor A cada objeto se le asigna un cuadro delimitador que predice una puntuación de confianza. En la cadena de suministro, se utiliza para identificar ciertos bienes y clasificarlos como defectuosos o no defectuosos. Ayuda a realizar el reconocimiento facial en diferentes dominios para detectar intrusos y alertar al equipo correspondiente. ¿Cómo funciona el reconocimiento de objetos? Un algoritmo exitoso de reconocimiento de objetos tiene dos factores influyentes: la eficiencia del algoritmo y el número de objetos o características en la imagen. La idea es alinear la imagen con el algoritmo de aprendizaje automático y extraer características relevantes para identificar y localizar los objetos presentes en ella. Las características pueden ser funcionales o geométricas en naturaleza. El resultado siempre es una predicción de clase lineal o binaria: Sí o No, según el modelo de datos que implementes. Así es como funciona: Extracción de características Los extractores de características son los operadores que descomponen una imagen en diferentes partes deformadas y extraen componentes desconocidos para la clasificación. Se obtiene principalmente mediante un algoritmo de aprendizaje automático supervisado o un modelo de red neuronal convolucional (CNN) entrenado como Alexnet o Inception. El algoritmo crea un mapa de características de la imagen para facilitar la identificación de objetos. Cuadro delimitador Cada parte de la imagen está encerrada dentro de un cuadro delimitador o cuadro de anclaje. El cuadro delimitador es estático para una imagen pero dinámico para identificar objetos en un video. Es un límite rectangular que restringe el movimiento del objeto o sus características para una clasificación más fácil. Los cuadros delimitadores pueden ayudar a extraer información como coordenadas gráficas, puntuación de probabilidad, altura, ancho, etc., junto con 25 elementos de datos más. Formación de hipótesis El número de características de imagen extraídas y la calidad de los datos de entrenamiento alimentados al algoritmo son elementos críticos de la formación de hipótesis. Después de la extracción de características, el sistema genera una puntuación de probabilidad y la asigna a los objetos presentes en la imagen. Esto se hace principalmente para reducir la carga de trabajo de un clasificador de aprendizaje automático. El resultado final se calcula en función de la puntuación de probabilidad y la predicción de clase para cada objeto en la imagen. Verificación de hipótesis En este punto, se verifica la hipótesis anterior, lo que resulta en una puntuación de clasificación media, es decir, una métrica utilizada por el algoritmo para calcular el rendimiento de la predicción de clase de diferentes objetos en la imagen. El modelo de IA implementado verifica características relevantes del objeto (forma, tamaño, color, etc.) y la predicción de clase por el cuadro delimitador que encierra el objeto. Una vez que se verifican ambos parámetros, el sistema asigna una puntuación compuesta final. Reconocimiento y mapeo Una vez que el algoritmo clasifica las características, mapea las coordenadas para el cuadro delimitador con el objeto. Esta información se alimenta a una máquina de vectores de soporte (SVM) que utiliza una herramienta de crecimiento de patrones frecuentes (FP) para predecir la clase del objeto en tiempo real. Las coordenadas o ejes se analizan horizontalmente o verticalmente, dado el aspecto y la simetría del plano. Regresión lineal Después de la predicción de clase, la imagen pasa por una regresión lineal para encontrar el tensor exacto (contenedor de datos numéricos devuelto por el regresor del objeto). La regresión se realiza utilizando plataformas de código abierto como Darknet, TensorFlow o PyTorch. El resultado final del algoritmo de reconocimiento de objetos comprende la categorización de la clase de objeto junto con detalles de su cuadro delimitador para especificar la ubicación exacta del objeto en la imagen. ¿Sabías que? El tamaño del mercado global de reconocimiento de imágenes crecerá de $26.2 mil millones en 2020 a $53.0 mil millones para 2025, a una tasa de crecimiento anual compuesta (CAGR) del 15.1% de 2020 a 2025. Fuente: MarketsandMarkets Algoritmos de reconocimiento de objetos El enfoque para el reconocimiento de objetos es principalmente doble: algoritmos de aprendizaje automático o modelos de red neuronal convolucional (CNN) basados en aprendizaje profundo. Para realizar una tarea de reconocimiento de objetos utilizando un enfoque de aprendizaje automático, necesitas un extractor de características que identifique información de objetos previamente desconocida para diferenciar entre categorías de etiquetas generales. Por otro lado, usar una red CNN para el reconocimiento de objetos no requiere extracción manual de características ni pruebas de hipótesis. Puede ayudar a detectar objetos y su ubicación directamente prediciendo las propiedades del cuadro delimitador que lo encierra. Sigue leyendo para conocer algunos algoritmos estándar que se pueden usar para realizar el reconocimiento de objetos en diferentes industrias. Algoritmos de aprendizaje automático El aprendizaje automático es uno de los enfoques más populares para verificar la presencia de un objeto. El algoritmo de aprendizaje automático es un modelo de datos de análisis predictivo que se puede entrenar en numerosas categorías, es decir, coches, bicicletas, montañas, etc. Varios algoritmos de aprendizaje automático supervisado y no supervisado ofrecen muchas combinaciones de extractores de características y conjuntos de datos de modelos que ejecutan tareas de reconocimiento de objetos de manera eficiente y precisa. Veamos algunos de ellos: Algoritmo de Viola-Jones El algoritmo de Viola-Jones es uno de los marcos de reconocimiento de objetos más populares. Su objetivo principal es permitir que el sistema vea rostros humanos en una configuración recta utilizando el siguiente proceso: La imagen capturada desde una cámara o una cámara web se reduce para crear una nueva imagen. Características como la boca o la nariz y su relación entre sí se programan manualmente y se agregan a la nueva imagen. El algoritmo de Viola-Jones se ejecuta en la nueva imagen para crear una serie de elementos de salida que coinciden con las características existentes del objeto. Las salidas se alimentan a una máquina de vectores de soporte para identificar la clase de objetos en la imagen, por ejemplo, el rostro. Poco después de su lanzamiento, el algoritmo de Viola-Jones se implementó en OpenCV y se hizo famoso como una de las técnicas más exitosas para realizar el reconocimiento de objetos. Sin embargo, un desafío que surgió fue que no pudo identificar objetos con oclusión parcial o configuraciones deformadas. Consejo: Un clasificador de OpenCV es un enfoque basado en aprendizaje automático utilizado para verificar la veracidad de la clase de objeto a través de la función de cascada. OpenCV se puede usar con cualquier algoritmo de detección de objetos de aprendizaje automático. Histograma de Gradientes Orientados Una versión más viable del antiguo algoritmo, a saber, el Histograma de Gradientes Orientados (HOGG), salió en 2005. HOGG fue un algoritmo de aprendizaje automático mejorado ampliamente utilizado en la detección de peatones y el procesamiento de imágenes para el reconocimiento de objetos. Así es como funciona: El sistema visualizó una imagen dada como una serie de píxeles. Para cada píxel, calculó cuán oscuro era su gradiente en comparación con el píxel circundante. Se dibujó una flecha, apuntando hacia el píxel más oscuro. Este proceso se repitió hasta que cada píxel fue reemplazado. Una matriz de flechas o gradientes separó la imagen en pequeños cuadrados (16x16). Cada cuadrado apuntaba hacia el lugar donde la imagen estaba oscura. Las flechas que capturaron la esencia exacta del objeto reemplazan los cuadrados. El sistema comparó la salida con la imagen original utilizando métricas como la distancia euclidiana o de Minkowski. Basado en un valor umbral, determinó si la imagen dada era un objeto o no. HOGG se volvió extremadamente popular ya que era rápido de calcular y proporcionaba un modelo mucho más estable para que el clasificador de objetos funcionara con precisión. Transformada de Características Invariantes a la Escala La Transformada de Características Invariantes a la Escala (SIFT) es un algoritmo de visión por computadora popular que ayuda a identificar objetos en imágenes digitales a través de bordes de esquina. Más como una técnica de detección de bordes, SIFT identifica toda la línea de escaneo de una imagen y traza gráficamente puntos clave específicos utilizando una función logarítmica. Una vez que las características están localizadas, pasa esta información cuantitativa o descriptores a un clasificador para categorizar los objetos y encontrar su ubicación específica en la imagen. Algoritmo de Bolsa de Características El algoritmo de "bolsa de características" o "bolsa de palabras" analiza aleatoriamente diferentes características de un objeto para identificar su categoría. Construido sobre la tecnología de Procesamiento de Lenguaje Natural (NLP) en evolución, es un algoritmo de aprendizaje automático no supervisado que interpreta características del mundo real, las almacena en un diccionario e improvisa su algoritmo para obtener mejores resultados. Aprendizaje profundo La era del aprendizaje profundo comenzó oficialmente en 2012. Con el aumento de la tecnología automotriz, la vigilancia inteligente por video y los nuevos estándares de API, las tareas de reconocimiento de objetos se han vuelto relativamente simples. Sin embargo, hay mucho trabajo que viene con la resolución de problemas de reconocimiento de objetos a través del aprendizaje profundo, ya que requiere suficiente potencia de unidad de procesamiento gráfico (GPU) y un gran conjunto de datos de entrenamiento. La CNN es un modelo de aprendizaje profundo que resuelve tareas complejas de visión por computadora a través de inteligencia artificial. El modelo en sí tiene capas de entrada y salida específicas que imitan la estructura del cerebro. Las capas de este modelo representan axones, dendritas, puentes y fibras ópticas que ocurren naturalmente en el cerebro y que alimentan el sistema de visión humana. Aquí hay un par de algoritmos de aprendizaje profundo que mejoraron el alcance de la visión por computadora: Red neuronal convolucional basada en regiones (R-CNN) La red neuronal convolucional basada en regiones (R-CNN) es un modelo autoentrenado de alto rendimiento que funciona en el conjunto de datos VOC-2012 y el conjunto de datos ILSVRC 2021. El Desafío de Reconocimiento Visual a Gran Escala de ImageNet (ILSVRC) es una competencia académica anual que tiene un desafío separado para problemas de clasificación de imágenes, localización de objetos y detección de objetos. Se lleva a cabo con la intención de fomentar soluciones independientes y separadas para cada tarea que se puedan implementar a una escala más amplia. A continuación se muestra un proceso detallado de reconocimiento de imágenes a través de R-CNN. Primero, el usuario necesita generar un conjunto de cuadros delimitadores no categorizados para una imagen o "regiones candidatas" utilizando un algoritmo de búsqueda selectiva. A un alto nivel, el proceso de búsqueda selectiva observa la imagen a través de una serie de ventanas de diferentes tamaños. Cada región candidata agrupa las características de la imagen como forma, color, píxeles, intensidad, etc. Estos mapas de características de una imagen se pasan a través de un modelo CNN preentrenado (Alexnet CNN) para extraer características principales y calcular los elementos de salida. Una vez que se muestran los elementos de salida, se alimentan a un clasificador SVM para clasificar las etiquetas. Simultáneamente, los cuadros delimitadores se pasan a través de un regresor para localizar las coordenadas de los objetos junto con sus categorías. Limitaciones del algoritmo R-CNN Aunque R-CNN demostró ser un modelo significativamente más rápido para entrenar un modelo de reconocimiento de objetos y hacer predicciones, todavía había algunas limitaciones en su funcionalidad. Aquí hay un conjunto de restricciones para R-CNN que lo impidieron de producir resultados precisos: La búsqueda selectiva, Alexnet CNN y el clasificador SVM tienen que ser entrenados en una base de datos de modelos y operados utilizando grandes cantidades de potencia de procesamiento gráfico. Entrenar una red neuronal simultáneamente en más de 2000 propuestas de región fue tedioso y llevó mucho tiempo. El modelo compiló cada región candidata una por una secuencialmente mientras se probaba. Como no escaneó toda la imagen de una vez, las predicciones reales estaban parcialmente ocultas y borrosas. ¿Sabías que? Recientemente se han propuesto modelos de reconocimiento de objetos más eficientes, a saber, Fast R-CNN, Faster R-CNN y Mask R-CNN. Estos algoritmos han sido preentrenados en grandes conjuntos de datos como VGG-16 y PASCAL VOC y producen predicciones de clase de última generación. You Only Look Once (YOLO) Al igual que la analogía de "solo vives una vez", YOLO es una red neuronal convolucional que analiza datos de una vez por todas. Ha sido lanzado en los últimos años. De todos los enfoques para realizar tareas de reconocimiento de objetos, YOLO es el más preciso. Observa una imagen solo una vez, pero de una manera inteligente. La extracción de características de una imagen o video a través de YOLO está libre de residuos y es completamente fluida. Reduce la probabilidad asignada por el sistema de que un objeto pertenezca a una clase específica en cierta cantidad, lo que resulta en un modelo más estable y una clasificación precisa de objetos. Aquí hay una descripción general estandarizada de cómo funciona YOLO: La imagen se divide en una cuadrícula de 13*13 = 169 celdas de dimensiones iguales. Cada celda de la imagen es responsable de la predicción de hasta 5 cuadros delimitadores. En algún momento, los cuadros delimitadores se superponen a fragmentos de objetos dentro de la pequeña celda. Una vez que se superpone a un objeto, asigna una puntuación de confianza que predice si el cuadro delimitador ha capturado un objeto o no. Además de predecir la presencia del cuadro delimitador, el modelo YOLO también asigna una clase específica (por ejemplo, semáforos, persona, coche, etc.) a cada cuadro delimitador. Un total de 169*5 o 845 cuadros delimitadores se asignan diferentes intervalos de confianza en toda la imagen. El intervalo de confianza se combina con la predicción de clase del objeto. Basado en un número umbral, se eliminan todos los cuadros delimitadores innecesarios y la imagen solo queda con 2 a 3 cuadros que se ajustan perfectamente al objeto. Implementación de YOLO para el reconocimiento de objetos YOLO no es un clasificador tradicional. La red neuronal se ejecuta una vez en la imagen. Cada celda en la cuadrícula de la imagen tiene un valor tensor específico. En este caso, cada celda predice cinco cuadros delimitadores. Cada cuadro delimitador es responsable de orquestar 25 elementos de datos para el objeto subyacente. Estos elementos pueden incluir altura, ancho, coordenadas del cuadro (bx, by), puntuación de probabilidad o intervalo de confianza. Por lo tanto, el valor tensor, en este caso, será 25*5 = 125. La red neuronal YOLO asigna un valor de probabilidad a cada parte de la imagen, lo que facilita al reconocedor identificar y localizar la presencia de objetos en la imagen. Consejo: La última versión de YOLO, YOLOv2 o YOLO9000, es una detección de objetos en tiempo real de una sola ejecución que ha sido entrenada en 9000 clases de objetos y puede ser incrustada en un archivo .mp3 o .mov para predecir cuadros delimitadores utilizando pesos predeclarados, clasificador softmax y anclas. ¿Por qué es importante el algoritmo YOLO? De todos los enfoques existentes para la visión por computadora, YOLO es el que mejor le da a una computadora la capacidad de identificar objetos en entornos reales e interactuar con ellos, casi tan bien como lo hacen los seres humanos. Como YOLO es una red neuronal convolucional, requiere mucha GPU y datos de entrenamiento para funcionar eficientemente. Aquí hay algunas razones por las que YOLO es el enfoque de reconocimiento de objetos más preferido en varios dominios de aplicaciones comerciales: Predice objetos en imágenes en tiempo real y funciona a una velocidad increíblemente rápida de 45 cuadros por segundo (FPS). Proporciona resultados precisos al reconocer objetos en imágenes. Con el tiempo, aprende a entender formas y patrones en imágenes desconocidas por sí mismo para clasificar su categoría. Técnicas más recientes de reconocimiento de objetos Implementar un método simple para el reconocimiento de objetos en lugar de enfoques de inteligencia artificial enredados es lo mejor. Tener un camino directo hacia los problemas reduce la complejidad cognitiva de un problema. Evita que el modelo del sistema recopile múltiples imágenes. Aquí hay algunas técnicas simples de reconocimiento de objetos que puedes usar para identificar objetos dentro de una imagen: Coincidencia de plantillas: La coincidencia de plantillas es una técnica donde el usuario compara la imagen con una plantilla preexistente, mapea la similitud de las características y asigna una etiqueta a la imagen. Los sistemas de reconocimiento de objetos basados en el reconocimiento de patrones funcionan completamente en técnicas de coincidencia de plantillas y no requieren ninguna formación de hipótesis para determinar objetos. Transformador visual: El transformador visual emplea una arquitectura similar a un transformador sobre parches de una imagen. La imagen se divide en parches más pequeños, cada uno proyectado en un codificador utilizando un clasificador lineal. La salida es un conjunto estándar de vectores que se encuentra con un nodo de clasificación para predecir la presencia de objetos. ¿Es el reconocimiento de objetos lo mismo que el reconocimiento facial? La técnica de reconocimiento facial y el reconocimiento de objetos son dos caras de la misma moneda. El reconocimiento facial es una tecnología de nueva generación que reconoce automáticamente estructuras similares a rostros dentro de una imagen para determinar su identidad. En tiempo real, el reconocimiento facial ayuda a detectar la presencia no identificada de seres humanos u objetos sospechosos en un espacio confinado con la ayuda de cámaras o dispositivos integrados. La usabilidad del reconocimiento facial abarca muchos dominios industriales diferentes, como la automatización de procesos robóticos (RPA), la detección biométrica y las operaciones de defensa. Aplicaciones de reconocimiento de objetos El reconocimiento de objetos está inextricablemente vinculado a muchas aplicaciones de la vida real en diferentes dominios comerciales. Se han realizado varias iteraciones para crear y afinar el reconocimiento de objetos para sectores comerciales y no comerciales. Hasta ahora, las empresas han tenido un éxito razonable en la realización de reconocimiento de objetos utilizando tecnología de IA estrecha. Aquí hay algunas aplicaciones de sistemas de reconocimiento de objetos en la vida real en diferentes dominios de investigación industrial: Seguridad y vigilancia: Oficinas y complejos residenciales han estado utilizando cámaras de CCTV tradicionales basadas en principios de reconocimiento visual de objetos. La gente ahora incluso usa sistemas de seguridad para sus actividades domésticas. Mientras que una cámara exterior ayuda a vigilar a los visitantes, las cámaras interiores ayudan a monitorear las acciones de un bebé. Imágenes satelitales y terrestres: El reconocimiento de objetos ayuda a detectar objetos en imágenes aéreas y presión atmosférica. También puede permitirnos predecir la posición de las placas tectónicas que se sacuden dentro de nuestro núcleo debido a la metamorfosis constante. La asistencia de la distribución de frecuencia de radio (RFID) permite a los pilotos y torres de control de tráfico aéreo (ATC) mantener una comunicación continua entre sí. Automóviles autónomos: El reconocimiento de objetos es una parte crucial de los automóviles autónomos. Los vehículos impulsados por el reconocimiento de objetos tienen la capacidad de moverse libremente sin que nadie controle el volante. Para garantizar una conducción segura, deben estar completamente equipados con visibilidad computacional. Los sensores activos como el lidar pesan la profundidad, posición y distancia relativa de los objetos que rodean los vehículos e identifican obstáculos y colisiones. Monitoreo de animales para avicultura: El reconocimiento e identificación de ganado como cerdos o cualquier otro ganado en múltiples granjas ahora es posible utilizando algoritmos de visión de IA y cámaras de vigilancia económicas. En comparación con otros métodos, la visión de IA ayuda a mantener un control sobre la salud y el bienestar de los animales. Esto lleva a una mejor calidad del producto y rentabilidad de los productos animales. Interacción avanzada humano-computadora: El reconocimiento de objetos establece un canal de interacción entre humanos y computadoras en diferentes dominios de aplicación. Ayuda a mejorar la comunicación bidireccional entre dos genes inteligentes dependientes o independientes y permite el envío y recepción precisos de señales. Aspiradoras robot: El reconocimiento de objetos es el punto de apoyo de la automatización de procesos robóticos. Las aspiradoras robot como los cyborgs y Roomba están impulsadas por tecnología de IA para limpiar pisos sin chocar con nada. Con la ayuda de una cámara incorporada y un sensor 3D, el robot reconoce objetos desde la distancia, los clasifica como distracciones y cambia de dirección. Reconocimiento de objetos y realidad aumentada El reconocimiento de objetos es uno de los vectores de rendimiento cruciales en el proceso de realidad aumentada. La realidad aumentada mejora la percepción de los usuarios del mundo natural a través de imágenes generadas por computadora, como gráficos, texto o sonidos. Con la ayuda del reconocimiento de objetos, se vuelve bastante simple detectar y manipular elementos de la vida real para transmitir información visual relevante y crear experiencias altamente atractivas. El reconocimiento de objetos es una técnica basada en marcadores que ayuda a registrar una conexión con un objeto del mundo real y rastrear su posición en tiempo real para superponer animaciones 3D sobre él. En otras palabras, el reconocimiento de objetos localiza puntos de alto contraste, curvas o bordes de objetos desde diferentes ángulos para crear una presentación de diapositivas virtual ante nuestros ojos. Pasando el don de la visión a las computadoras Hace años, ¿quién hubiera pensado que la inteligencia artificial ya no sería conocida como la "quinta generación de computadoras", sino como un cambio de juego actual para la humanidad? El reconocimiento de objetos pasa el testigo de la visión de los humanos a las computadoras. Tiene el potencial de transformar la esfera empresarial moderna al diseñar experiencias de cliente seguras y de última generación. El futuro del reconocimiento de objetos también depende de la evolución de la tecnología de inteligencia artificial. Al igual que la revolución industrial original, reducirá la mano de obra en el futuro y empoderará a los humanos para hacer lo que están mejor equipados para hacer: ser creativos y empáticos. Aborda el etiquetado de datos como un profesional con herramientas de aprendizaje activo y reduce los costos de infraestructura de IA organizacional mientras mantienes la mayor precisión.

¿Quieres aprender más sobre Software de reconocimiento de imágenes? Explora los productos de Reconocimiento de imágenes.

Shreya Mattoo

Shreya Mattoo is a Content Marketing Specialist at G2. She completed her Bachelor's in Computer Applications and is now pursuing Master's in Strategy and Leadership from Deakin University. She also holds an Advance Diploma in Business Analytics from NSDC. Her expertise lies in developing content around Augmented Reality, Virtual Reality, Artificial intelligence, Machine Learning, Peer Review Code, and Development Software. She wants to spread awareness for self-assist technologies in the tech community. When not working, she is either jamming out to rock music, reading crime fiction, or channeling her inner chef in the kitchen.